AI发展里程碑:欧盟《人工智能(néng)法案》要点解读

AI发展里程碑:欧盟《人工智能(néng)法案》要点解读

引言

当地时间2024年3月13日,欧洲议会在法國(guó)斯特拉斯堡以523票赞成、46票反对和49票弃权的压倒性多(duō)数通过了世界上第一个全面的人工智能(néng)法律框架——欧盟《人工智能(néng)法案》(下称“法案")。法案预计将在今年5月生效,相关条款分(fēn)阶段实施。法案不仅对在欧盟运营的公司至关重要,而且由于该法案的域外效力,对非欧盟公司也将产生深遠(yuǎn)影响。

一、法案的立法目的

法案由欧盟委员会于2021年4月21日正式提出,历时近3年终于通过,旨在改善欧盟内部市场,促进以人為(wèi)本、值得信赖的人工智能(néng)的应用(yòng),同时高度保护健康、安全、以及《欧盟基本权利宪章》规定的基本权利(包括民(mín)主、法治和环境保护),使其免受人工智能(néng)带来的不利影响,并支持创新(xīn)。

法案為(wèi)整个人工智能(néng)产业链上的相关方提供了一个合规义務(wù)框架,以规范人工智能(néng)的开发和使用(yòng)。与欧盟《通用(yòng)数据保护条例》(GDPR)一样,欧盟正通过其先发优势,寻求為(wèi)人工智能(néng)监管制定全球标准。

二、法案的主要内容

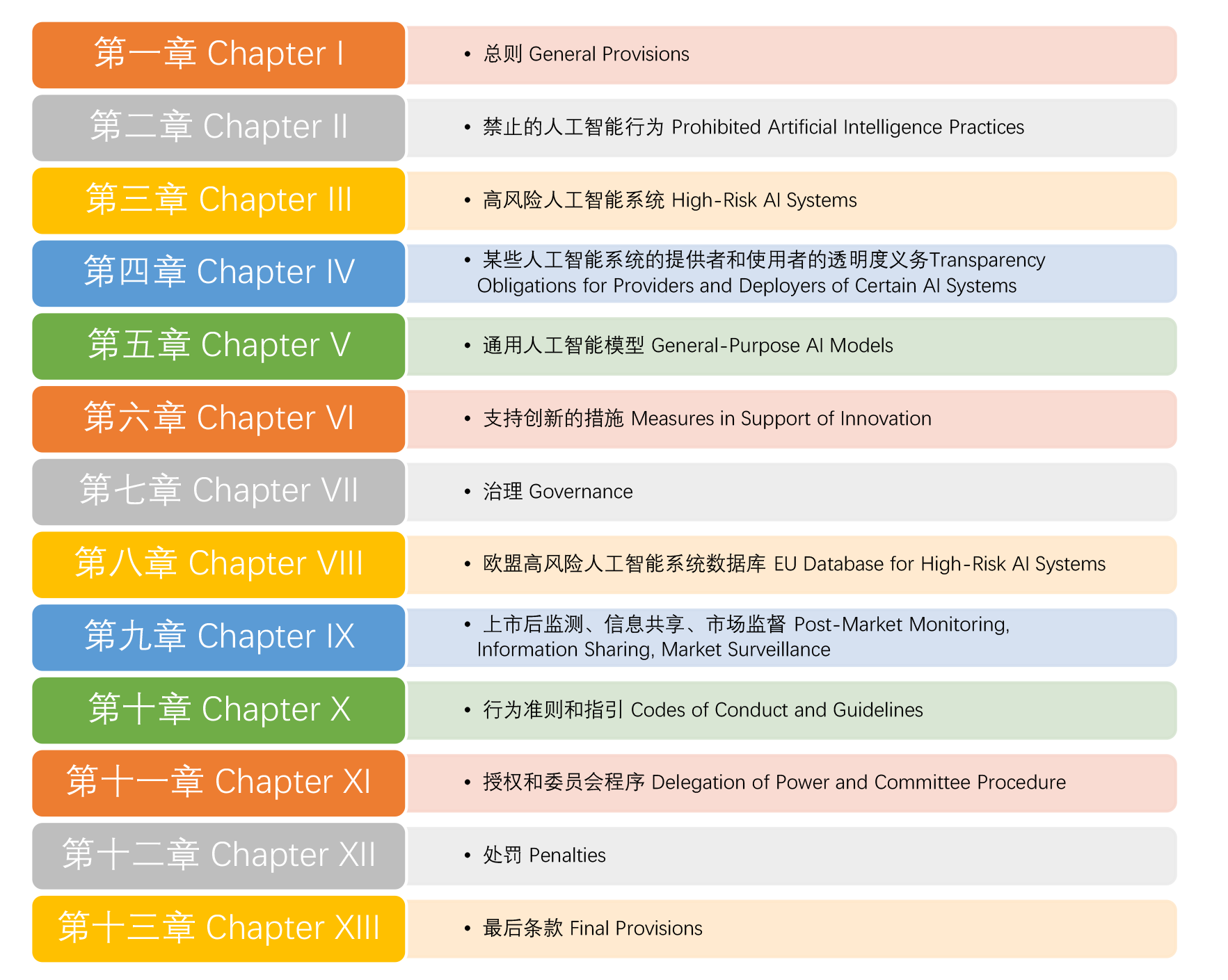

法案共计13章、113条,包括以下7个方面的内容:(1)人工智能(néng)系统(AI System)在欧盟市场上的投放、服務(wù)和使用(yòng)的统一规则;(2)禁止某些人工智能(néng)行為(wèi);(3)对高风险人工智能(néng)系统的具體(tǐ)要求以及此类系统运营商(shāng)的义務(wù);(4)某些人工智能(néng)系统的统一透明度规则;(5)通用(yòng)人工智能(néng)模型投放市场的统一规则;(6)关于市场监测、市场监督治理(lǐ)和执法的规则;(7)支持创新(xīn)的措施,特别关注包括初创企业在内的中小(xiǎo)企业。

我们将针对法案的适用(yòng)范围、人工智能(néng)系统风险分(fēn)级管理(lǐ)、通用(yòng)人工智能(néng)模型管理(lǐ)、执法与处罚、法案的生效与实施5项重要内容进行详细阐述。

欧盟《人工智能(néng)法案》的章节目录

(一)法案的适用(yòng)范围

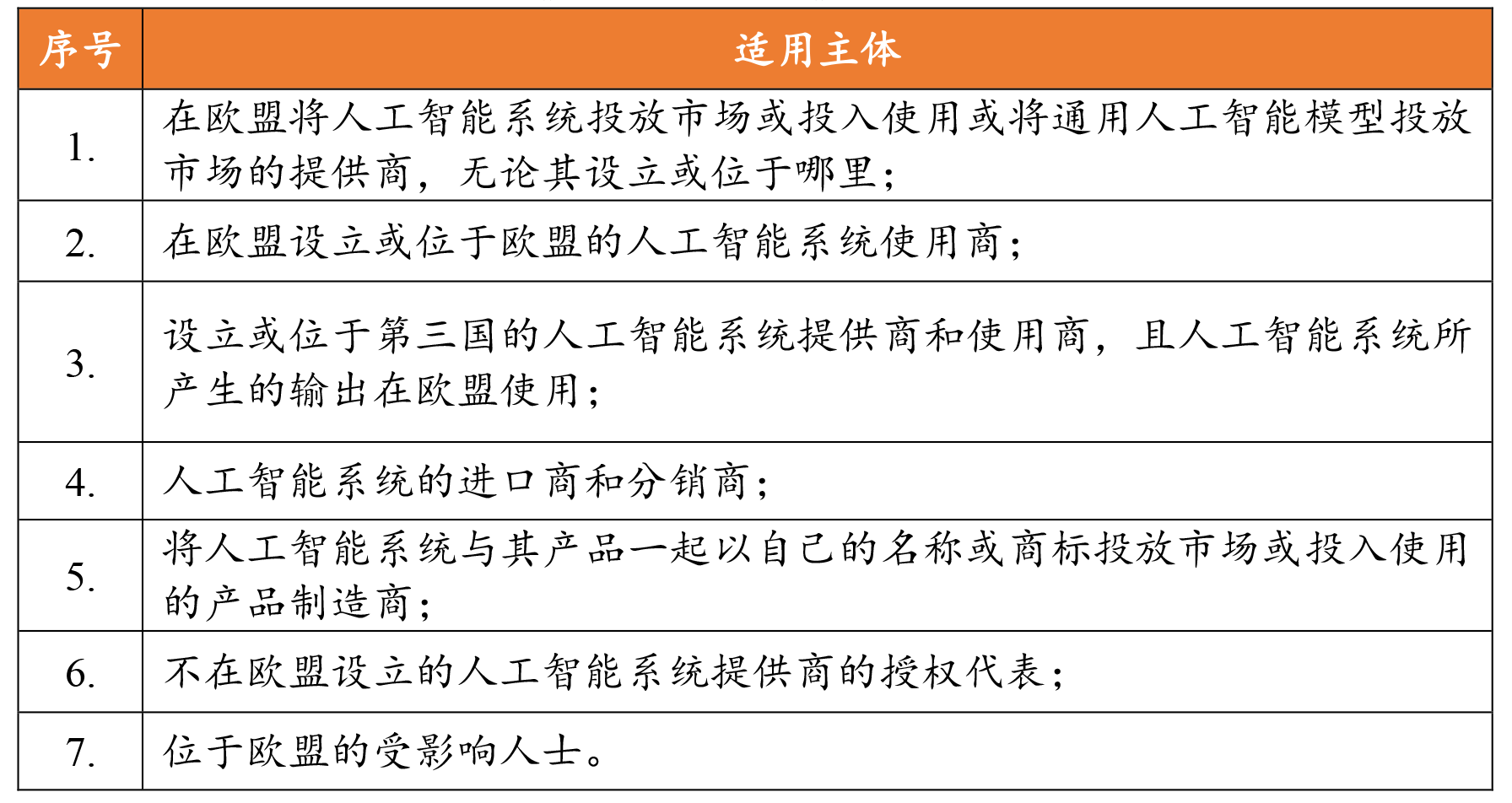

法案适用(yòng)主體(tǐ)广泛,旨在规范整个人工智能(néng)产业链的主體(tǐ),包括与欧盟市场有(yǒu)连接点的人工智能(néng)系统提供商(shāng)(providers)、使用(yòng)商(shāng)(deployers)、进口商(shāng)(importers)、分(fēn)销商(shāng)(distributors)和产品制造商(shāng)(product manufacturers)。

“人工智能(néng)系统"是指一种基于机器而以不同程度的自主性运行、在使用(yòng)后可(kě)能(néng)表现出适应性的系统,且基于明确或隐含的目标,该系统从其接收的输入中推断出如何生成可(kě)能(néng)会影响物(wù)理(lǐ)或虚拟环境的输出,如预测、内容、建议或决策。该定义的关键词在于“推断"和“自主",这两个关键词将人工智能(néng)系统与任何其他(tā)通过严格算法预先确定输出的软件明确區(qū)分(fēn)。这一定义遵循了经济合作与发展组织(OECD)的相关定义,以确保其适用(yòng)范围不仅足以预见未来的技术进步,而且还能(néng)确保进行简单自动计算的传统软件不在该法案的规制范畴。

欧盟《人工智能(néng)法案》的适用(yòng)主體(tǐ)

当然,法案也规定了一些适用(yòng)的例外情形,包括但不限于(1)法案不适用(yòng)于仅為(wèi)科(kē)學(xué)研究和开发目的而专门开发和投入使用(yòng)的人工智能(néng)系统或人工智能(néng)模型及其输出;(2)法案不适用(yòng)于在纯粹个人非专业活动中使用(yòng)人工智能(néng)系统的自然人;(3)法案不适用(yòng)于专门為(wèi)军事、國(guó)防或國(guó)家安全目的而投放市场、投入使用(yòng)的人工智能(néng)系统,无论开展这些活动的实體(tǐ)属于何种类型。

法案具有(yǒu)广泛的域外适用(yòng)效力,因此,不少中國(guó)企业也在其适用(yòng)范围之内,应予以关注。

(二)人工智能(néng)系统风险分(fēn)级管理(lǐ)

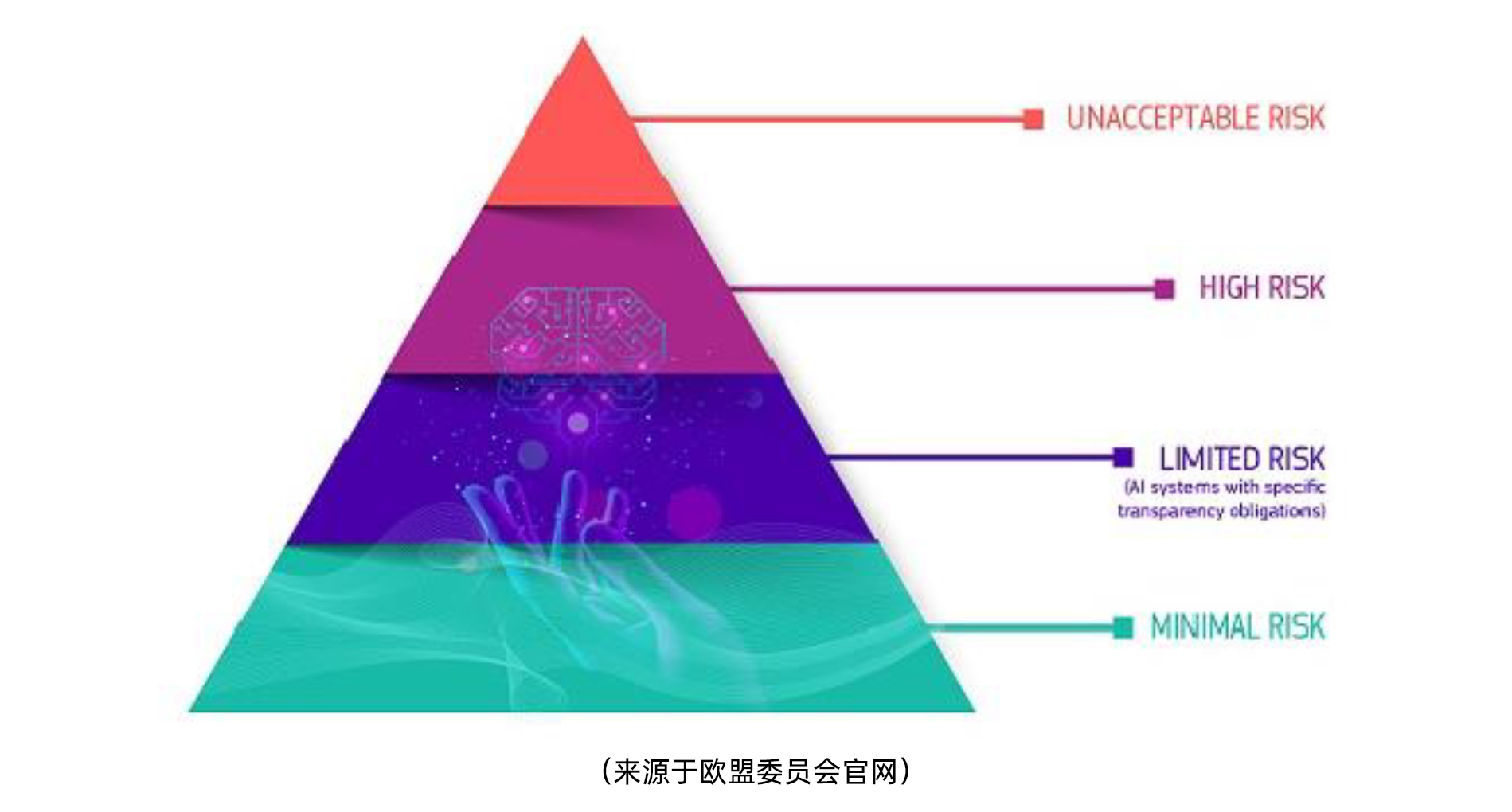

法案基于人工智能(néng)系统对用(yòng)户和社会的潜在影响程度将其分(fēn)為(wèi)4类:不可(kě)接受风险类、高风险类、有(yǒu)限风险类、最小(xiǎo)风险类。[1]每个类别适用(yòng)不同程度的监管要求。高风险的人工智能(néng)系统须遵守更严格的合规要求,而构成不可(kě)接受风险的人工智能(néng)系统则被禁止。多(duō)数人工智能(néng)系统属于风险较低的类别,但仍可(kě)能(néng)需要根据法案要求履行相应义務(wù)。

欧盟《人工智能(néng)法案》划分(fēn)的人工智能(néng)系统风险等级

1. 不可(kě)接受风险类人工智能(néng)系统

法案严格禁止某些人工智能(néng)行為(wèi)。从广义上讲,该法案禁止任何试图操纵人类行為(wèi)、利用(yòng)人性弱点或支持政府社会评分(fēn)的人工智能(néng)系统。具體(tǐ)而言,以下人工智能(néng)系统将被禁止:

(1)使用(yòng)潜意识的、操纵性的、或欺骗性的手段来扭曲行為(wèi),损害知情决策的能(néng)力,造成重大伤害;

(2)利用(yòng)与年龄、残疾或社会经济状况有(yǒu)关的弱点来扭曲行為(wèi),造成重大伤害;

(3)推断敏感属性(种族、政治观点、工会会员身份、宗教或哲學(xué)信仰、性生活或性取向)的生物(wù)识别分(fēn)类系统,但合法获取的生物(wù)识别数据集的标记或过滤,以及执法部门对生物(wù)识别数据进行分(fēn)类的情况除外;

(4)社会评分(fēn),即根据社会行為(wèi)或个人特征对个人或群體(tǐ)进行评估或分(fēn)类,从而对这些人造成不利或不利待遇;

(5)仅根据特征分(fēn)析或个性特征评估个人实施刑事犯罪的风险,除非是根据与犯罪活动直接相关的客观的、可(kě)核实的事实来加强人工评估;

(6)通过无针对性地从互联网或闭路電(diàn)视录像中抓取面部图像来编制面部识别数据库;

(7)在工作场所或教育机构进行情绪识别,除非出于医疗或安全原因;

(8)在公共场所為(wèi)执法部门进行“实时"遠(yuǎn)程生物(wù)识别(RBI),但以下情况除外:

寻找失踪人员、绑架受害者和被贩卖或遭受性剥削的人;

防止对生命的重大和紧迫威胁,或可(kě)预见的恐怖袭击;或

识别严重犯罪(如谋杀、强奸、武装抢劫、毒品和非法武器贩运、有(yǒu)组织犯罪和环境犯罪等)的嫌疑人。

2. 高风险类人工智能(néng)系统

高风险类的人工智能(néng)系统被认為(wèi)对健康、安全、基本权利和法治构成重大威胁。法案规定的大部分(fēn)义務(wù)适用(yòng)于高风险的人工智能(néng)系统。这类系统可(kě)以进一步分(fēn)為(wèi)两类。一类是人工智能(néng)系统作為(wèi)安全部件的产品或人工智能(néng)系统本身作為(wèi)产品,受欧盟安全立法规范,且需要根据此类法律进行第三方符合性评估。另一类是法案附件III(Annex III)明确指定為(wèi)高风险的人工智能(néng)系统,包括用(yòng)于以下领域的人工智能(néng)系统:

(1)用(yòng)于未被禁止的生物(wù)识别系统,包括推断受保护特征的系统、情感识别系统和遠(yuǎn)程生物(wù)识别系统(不包括对个人的生物(wù)识别验证);

(2)用(yòng)于管理(lǐ)关键基础设施;

(3)用(yòng)于教育和职业培训;

(4)用(yòng)于就业、员工管理(lǐ)和自营职业机会;

(5)用(yòng)于获得和享受基本私人服務(wù)以及基本公共服務(wù)和福利,如医疗保健或信贷(但用(yòng)于金融检测欺诈的除外);

(6)用(yòng)于执法;

(7)用(yòng)于移民(mín)、庇护和边境管制管理(lǐ);

(8)用(yòng)于司法和民(mín)主进程。

如果人工智能(néng)系统不会对自然人的健康、安全或基本权利造成重大损害风险,包括不会对决策结果产生实质性影响,则不会被视為(wèi)高风险系统。在将属于附件III但被视為(wèi)非高风险的人工智能(néng)系统投放市场之前,提供商(shāng)必须将其风险评估记录在案,并在欧盟数据库中注册该系统。前述评估应考虑到可(kě)能(néng)造成伤害的严重性及其发生的概率。如果人工智能(néng)系统符合某些情况,例如,如果该系统只是為(wèi)了执行狭义的程序任務(wù)或改善先前完成的人类活动的结果,则该系统可(kě)能(néng)不会被认定為(wèi)高风险系统。然而,如果人工智能(néng)系统会对自然人进行特征分(fēn)析,则该系统始终会被认定為(wèi)高风险系统。

所有(yǒu)使用(yòng)高风险人工智能(néng)系统的企业都必须履行广泛的义務(wù),包括满足有(yǒu)关透明度、数据质量、记录保存、人工监督和稳健性的具體(tǐ)要求。在进入市场之前,它们还必须接受符合性评估(Conformity Assessments),以证明它们满足法案的要求。公民(mín)将有(yǒu)权提交有(yǒu)关人工智能(néng)系统的投诉,并获得对基于高风险人工智能(néng)系统、影响其权利的决定的解释。

高风险人工智能(néng)系统投放市场应履行的步骤

3. 有(yǒu)限风险类人工智能(néng)系统

有(yǒu)限风险类人工智能(néng)系统被认為(wèi)不会构成任何严重威胁,与其相关的主要风险是缺乏透明度。法案对有(yǒu)限风险类人工智能(néng)系统施加了一定的透明度义務(wù),以确保所有(yǒu)人类用(yòng)户在与人工智能(néng)系统互动时都能(néng)充分(fēn)了解相关情况。例如,在使用(yòng)聊天机器人等人工智能(néng)系统时,应让人类意识到他(tā)们正在与一台机器进行交互,以便他(tā)们在知情的情况下决定是否继续。提供商(shāng)还必须确保人工智能(néng)生成的内容是可(kě)识别的。此外,人工智能(néng)生成的文(wén)本在发布时必须标明是人工生成的,这也适用(yòng)于构成深度伪造的音频和视频内容。

4. 最小(xiǎo)风险类人工智能(néng)系统

法案允许自由使用(yòng)最小(xiǎo)风险类的人工智能(néng)系统,包括人工智能(néng)電(diàn)子游戏或垃圾邮件过滤器等应用(yòng)。欧盟目前使用(yòng)的绝大多(duō)数人工智能(néng)系统都属于这一类。

(三)通用(yòng)人工智能(néng)模型的管理(lǐ)

根据法案,通用(yòng)人工智能(néng)模型是一个包括使用(yòng)大量数据进行大规模自我监督训练的人工智能(néng)模型。该模型具有(yǒu)显著的通用(yòng)性,无论以何种方式投放市场,都能(néng)胜任各种不同的任務(wù),并可(kě)集成到各种下游系统或应用(yòng)中,但在投放市场前用(yòng)于研究、开发或原型设计活动的人工智能(néng)模型除外。法案将通用(yòng)人工智能(néng)模型分(fēn)為(wèi)不具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型和具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型。如果通用(yòng)人工智能(néng)模型具有(yǒu)高度影响能(néng)力或被欧盟委员会认定為(wèi)具有(yǒu)高度影响能(néng)力,则被视為(wèi)构成系统性风险。当一个通用(yòng)人工智能(néng)模型用(yòng)于训练的累计计算量(以FLOPs计)大于10^25时,应推定其具有(yǒu)高度影响能(néng)力。

1. 不具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型

越来越多(duō)的通用(yòng)人工智能(néng)模型正在成為(wèi)人工智能(néng)系统的组成部分(fēn),这些模型可(kě)以执行和适应无数不同的任務(wù)。虽然通用(yòng)人工智能(néng)模型可(kě)以实现更好、更强大的人工智能(néng)解决方案,但人类很(hěn)难监控其所有(yǒu)能(néng)力。因此,法案為(wèi)所有(yǒu)通用(yòng)人工智能(néng)模型引入了透明度义務(wù),以便更好地了解这些模型。

具體(tǐ)而言,不具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型提供商(shāng)应履行的义務(wù)包括但不限于:

(1)编制并不断更新(xīn)该模型的技术文(wén)件,包括其训练和测试过程以及评估结果,以便应要求向欧盟人工智能(néng)办公室和國(guó)家主管当局提供;

(2)為(wèi)打算将通用(yòng)人工智能(néng)模型纳入其人工智能(néng)系统的提供商(shāng)编制、不断更新(xīn)和提供信息和文(wén)件;

(3)制定遵守欧盟版权法的政策;

(4)根据欧盟人工智能(néng)办公室提供的模板,就通用(yòng)人工智能(néng)模型训练所使用(yòng)的内容起草(cǎo)并公布一份足够详细的摘要。

2. 具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型

除应履行上述义務(wù)外,具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型的提供商(shāng)应履行额外的风险管理(lǐ)义務(wù),包括但不限于:

(1)根据反映最新(xīn)技术的标准化协议和工具进行模型评估,包括对模型进行对抗测试并记录在案,以识别和降低系统性风险;

(2)评估并降低欧盟层面可(kě)能(néng)存在的系统性风险,包括因开发、投放市场、或使用(yòng)具有(yǒu)系统性风险的通用(yòng)人工智能(néng)模型而产生的系统性风险的来源;

(3)跟踪、记录并及时向欧盟人工智能(néng)办公室报告,并酌情向國(guó)家主管机构报告严重事故的相关信息以及為(wèi)解决这些问题可(kě)能(néng)采取的纠正措施;

(4)确保对具有(yǒu)系统风险的通用(yòng)人工智能(néng)模型和模型的物(wù)理(lǐ)基础设施提供适当水平的网络安全保护。

(四)执法与处罚

欧盟人工智能(néng)办公室成立于2024年2月,隶属于欧盟委员会,负责监督法案在各成员國(guó)的执行和实施情况。由成员國(guó)代表组成的欧洲人工智能(néng)委员会将作為(wèi)协调平台,向欧盟委员会提供专业建议。法案将主要通过各成员國(guó)的主管机构来执行。成员國(guó)有(yǒu)义務(wù)在法案实施1年内向欧盟委员会提名相关國(guó)家主管机构,以便在每个成员國(guó)执行法案。

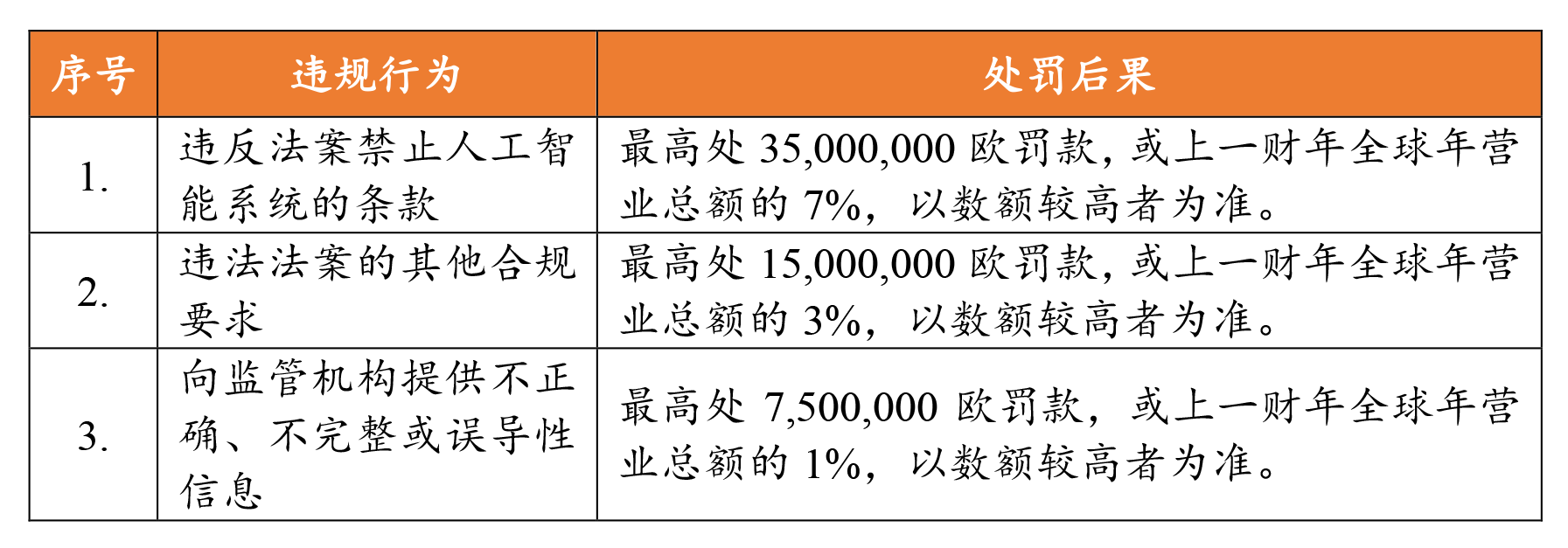

违反法案的处罚结果将取决于人工智能(néng)系统的类型、公司的规模和违法行為(wèi)的严重程度,具體(tǐ)处罚规定如下:

(五)法案的生效和实施

法案将在欧盟官方公报公布20天后生效,并在生效2年后全面实施,但以下情况除外:

1. 有(yǒu)关总则、禁止性人工智能(néng)系统的规定(法案第一、二章),在法案生效之日起6个月实施;

2. 有(yǒu)关通知机构和被通知机构、治理(lǐ)、通用(yòng)人工智能(néng)模型、处罚的规定(法案第三章第四节,第五、七、十二章,除第101条),在法案生效之日起12个月实施;

3. 有(yǒu)关某些高风险人工智能(néng)系统分(fēn)类及相应义務(wù)的规定(法案第六条),在法案生效之日起36个月实施。

三、结语

在人工智能(néng)蓬勃发展的当下,越来越多(duō)的人开始意识到自动化算法将直接影响他(tā)们的生活。在人工智能(néng)带给人类极大便利的同时,人们也在思考如何更合理(lǐ)地利用(yòng)人工智能(néng)造福人类,并不断探寻规范使用(yòng)和发展人工智能(néng)之道。欧盟《人工智能(néng)法案》树立了人类规范人工智能(néng)的典范,在人工智能(néng)发展史上具有(yǒu)里程碑意义。可(kě)以预见,在不久的将来,我们将迎来全球人工智能(néng)立法的热潮、执法的趋严,中國(guó)企业需要把握全球人工智能(néng)监管的脉搏,未雨绸缪,迎接新(xīn)的人工智能(néng)时代。

[注]

[1] 这种分(fēn)类方法类似于GDPR基于风险的数据处理(lǐ)方法。